Что такое контекст?

- Контекст намерения определяет, что пользователь хочет получить от модели. Например, системный промпт обычно служит высокоуровневыми инструкциями о том, как пользователь хочет, чтобы модель себя вела. Большая часть «промптинга» в Cursor — это контекст намерения. «Сделай эту кнопку зелёной вместо синей» — пример явного намерения; это предписывающая формулировка.

- Контекст состояния описывает текущее состояние. Предоставление Cursor сообщений об ошибках, логов консоли, изображений и фрагментов кода — примеры контекста, связанного с состоянием. Он описательный, а не предписывающий.

Предоставление контекста в Cursor

- Галлюцинациям, когда модель пытается подогнать паттерн (когда его нет), что приводит к неожиданным результатам. Это часто случается с моделями вроде

claude-3.5-sonnet, если им не хватает контекста. - Тому, что Agent пытается собрать контекст самостоятельно: искать по кодовой базе, читать файлы и вызывать инструменты. Сильная «думающая» модель (например,

claude-3.7-sonnet) может зайти довольно далеко с такой стратегией, и то, какой начальный контекст ты задашь, определит траекторию.

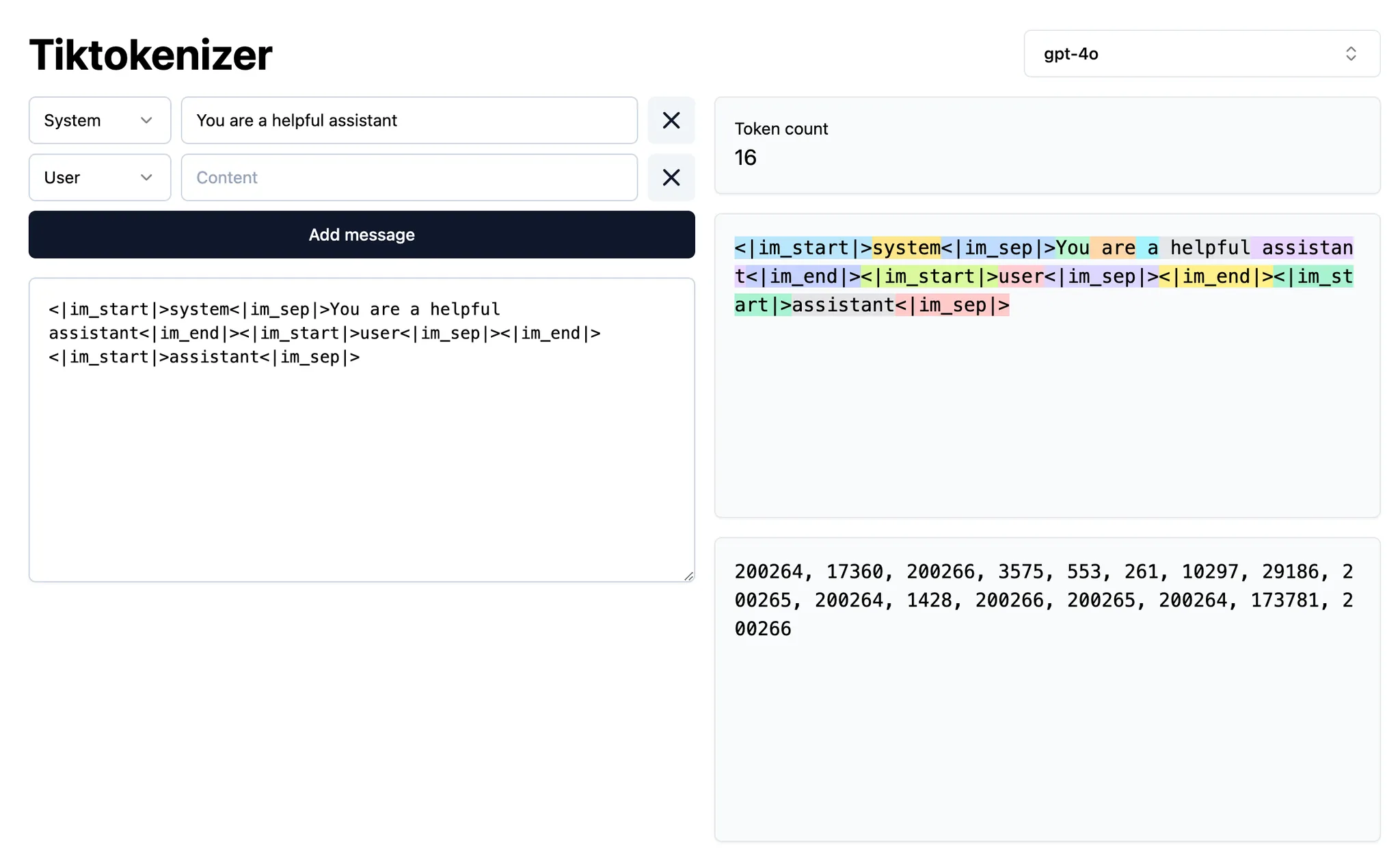

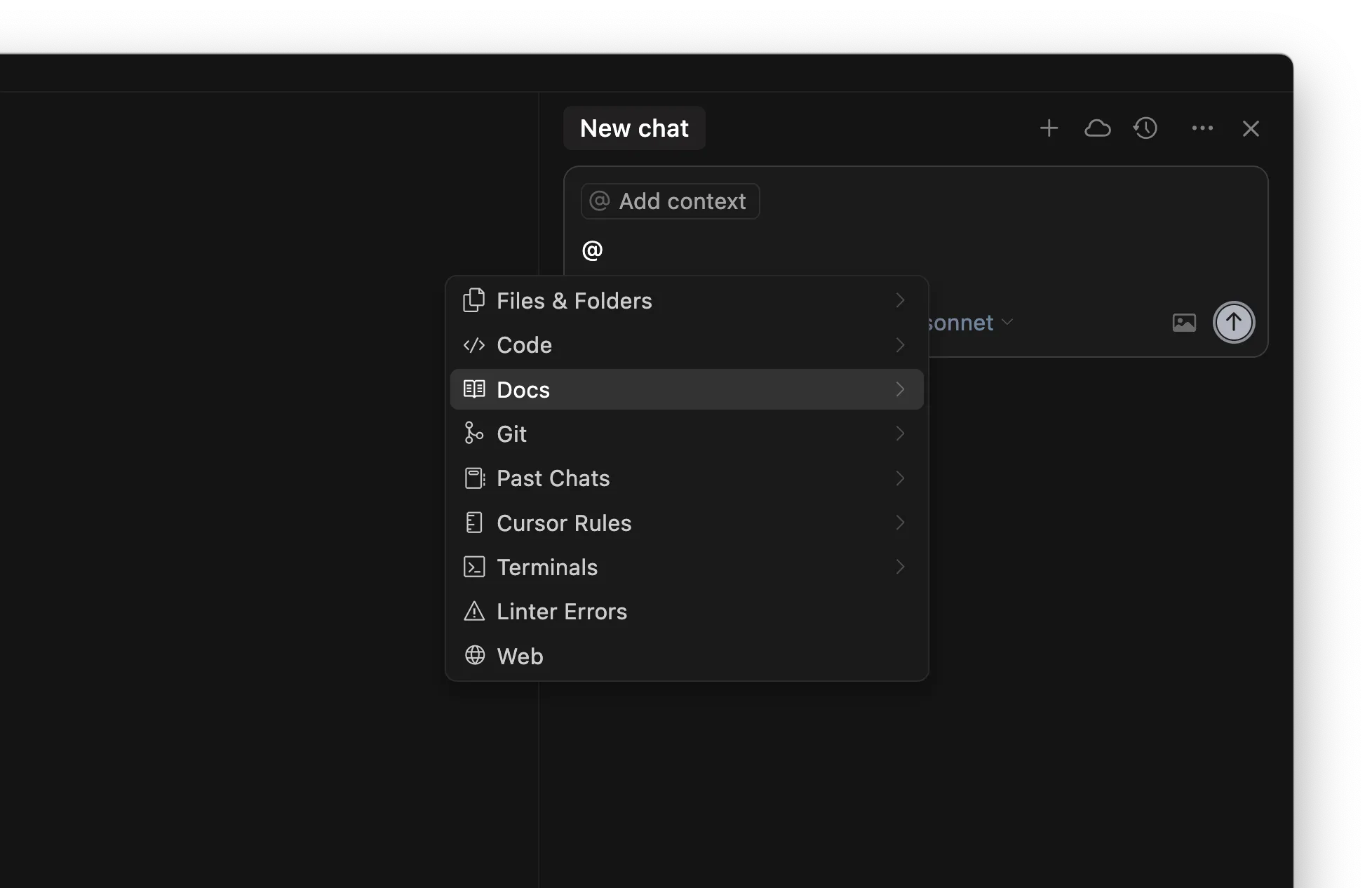

Символ @

| Symbol | Example | Use case | Drawback |

|---|---|---|---|

@code | @LRUCachedFunction | Ты знаешь, какая функция, константа или символ важны для результата, который ты получаешь | Требуется глубокое знание кодовой базы |

@file | cache.ts | Ты знаешь, какой файл нужно прочитать или отредактировать, но не знаешь точное место в нём | Может включать много лишнего контекста для текущей задачи в зависимости от размера файла |

@folder | utils/ | Всё или большинство файлов в папке имеют отношение к задаче | Может включать много лишнего контекста для текущей задачи |

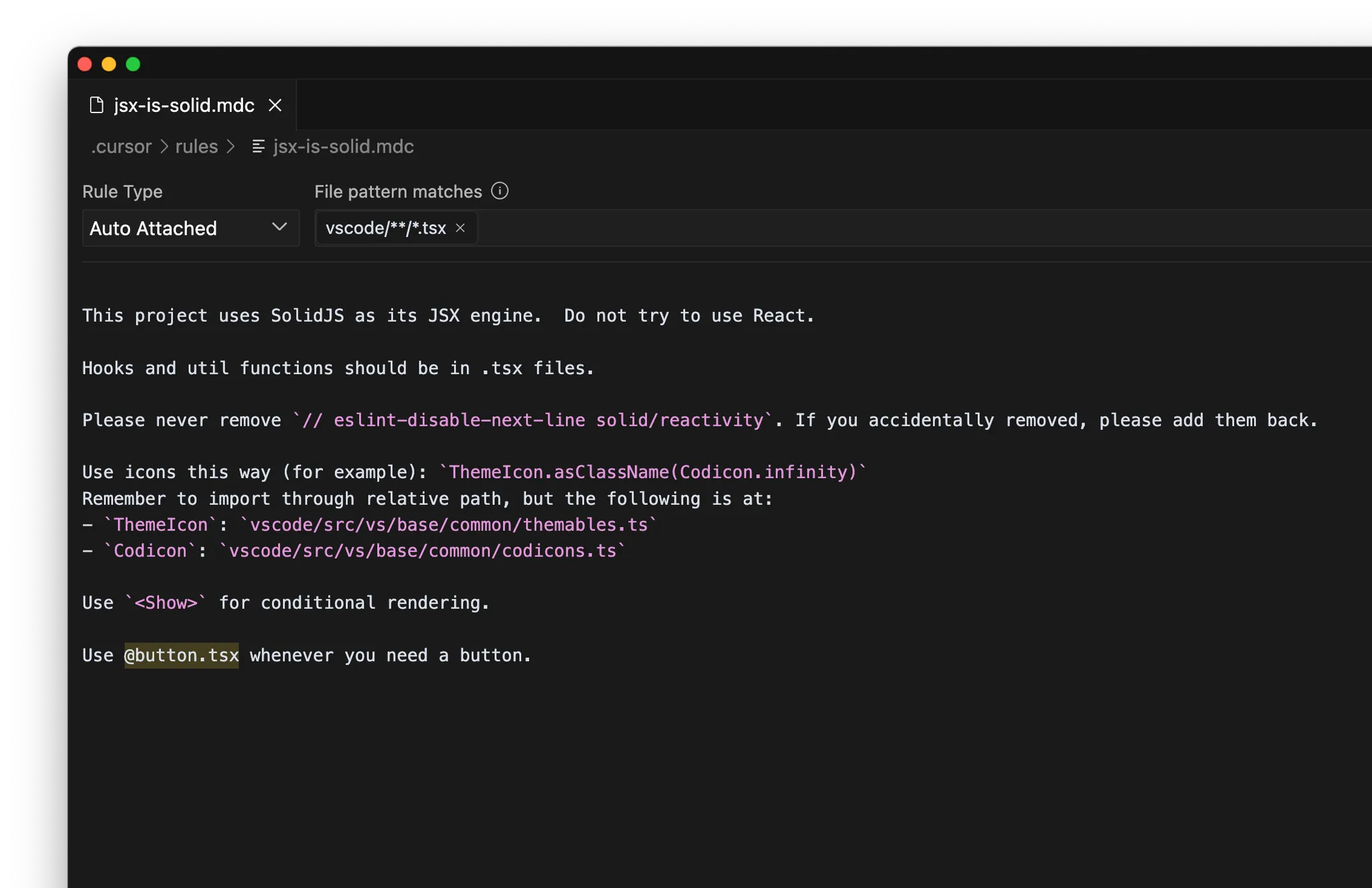

Правила

/Generate Cursor Rules. Если у тебя была длинная переписка с множеством промптов, скорее всего, там есть полезные директивы или общие правила, которые ты захочешь использовать позже.

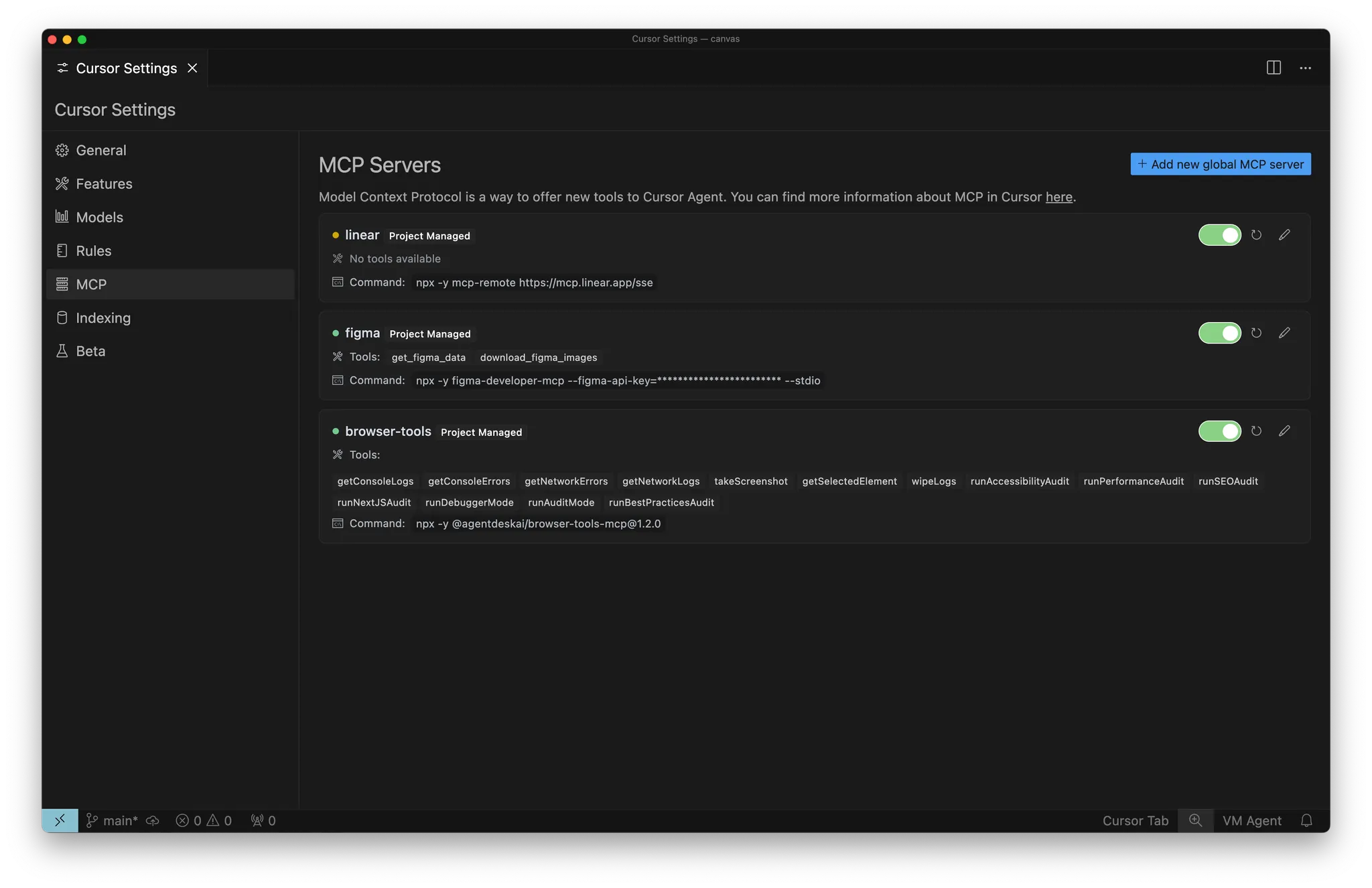

MCP

- Внутренняя документация: например, Notion, Confluence, Google Docs

- Управление проектами: например, Linear, Jira

Самосбор контекста

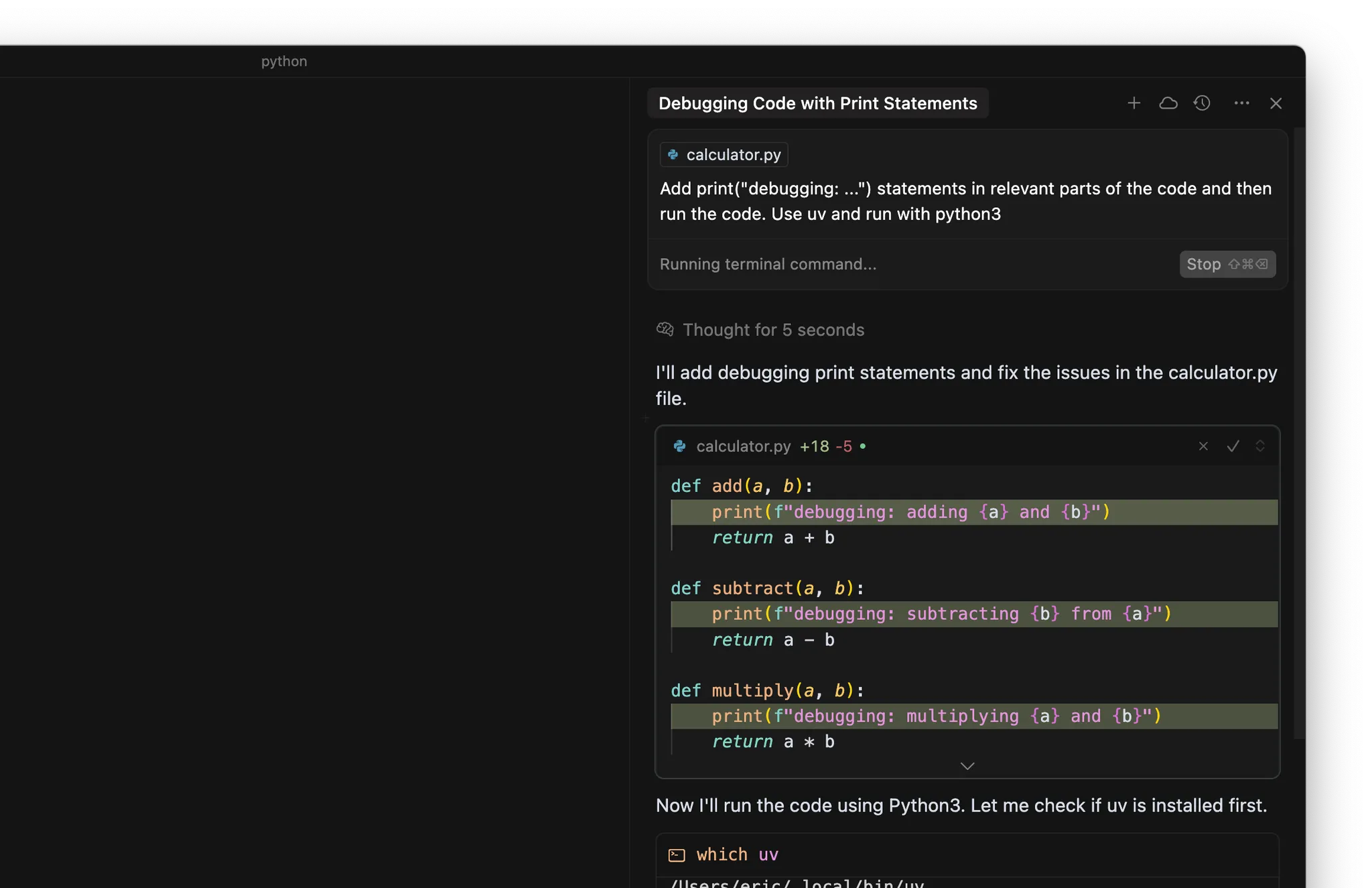

- Добавить в нужные части кода выражения print(“debugging: …”)

- Запустить код или тесты через терминал

Выводы

- Контекст — основа эффективного AI-кодинга. Он состоит из намерения (что ты хочешь) и состояния (что уже есть). Если указать оба, Cursor будет давать более точные ответы.

- Используй «хирургический» контекст с @-символами (@code, @file, @folder), чтобы направлять Cursor максимально точно, а не полагаться только на автоматический сбор контекста.

- Оформляй повторяемые знания в правила, чтобы переиспользовать их командой, и расширяй возможности Cursor через Model Context Protocol для подключения внешних систем.

- Недостаточный контекст ведёт к галлюцинациям или неэффективности, а избыток нерелевантного контекста размывает сигнал. Держи правильный баланс для оптимальных результатов.