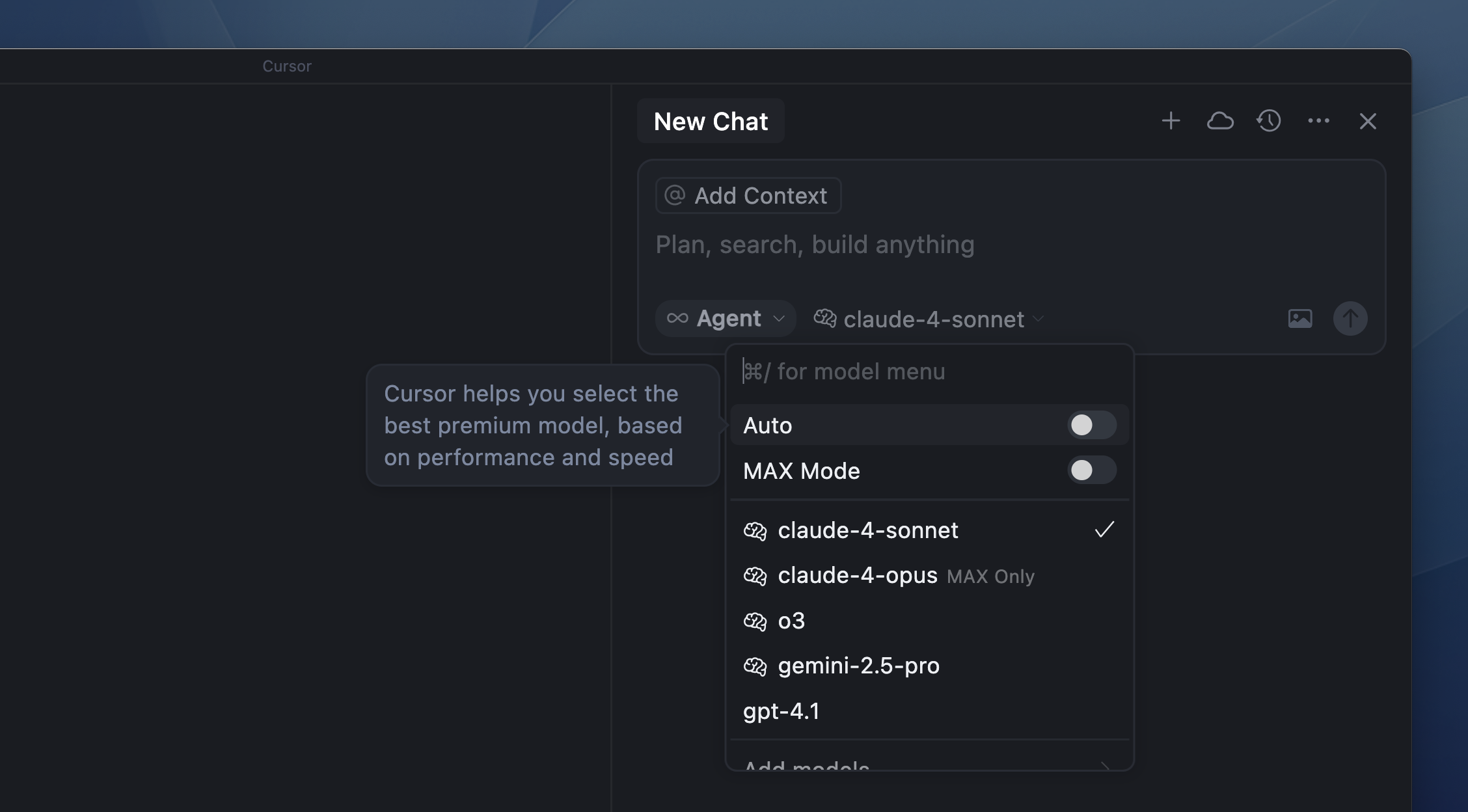

Цены на модели

Auto

Контекстные окна

Max Mode

FAQ

Где размещаются модели?

Где размещаются модели?

Модели размещаются на инфраструктуре в США — у провайдера модели, доверенного партнёра или непосредственно у Cursor.Когда включён Privacy Mode, ни Cursor, ни провайдеры моделей не сохраняют твои данные. Все данные удаляются после каждого запроса. Подробности см. на страницах Privacy, Privacy Policy и Security.